Laborator 06: Parcurgerea grafurilor. Aplicații (1/2)

Obiective laborator

- Înțelegerea conceptele de graf, reprezentare și parcugere

- Studierea unor aplicații pentru parcurgeri

Importanţă – aplicaţii practice

Grafurile sunt utile pentru a modela diverse probleme și au numeroase aplicații practice:

- Rețele de calculatoare (ex: stabilirea unei topologii fără bucle / arbore de acoperire)

- Pagini Web (ex. algoritmi de căutare - Google PageRank )

- Rețele sociale (ex. sugestii de prietenie pe Facebook)

- Hărți cu drumuri (ex. drum minim între două localități)

- Modelare grafică (ex. arbori de parționare)

- Rețele de transport (ex. flux)

Grafuri

Puteți consulta capitolul “Elementary Graph Algorithms” din “Introduction to Algorithms” [0] pentru mai multe definiții formale. Această secțiune sumarizează principalele notații folosite în laboratoarele de PA.

Definiții

Un graf G se definește ca fiind o pereche (V, E), unde V = {node / un nod oarecare din graf}, iar E = {(x, y) / (x, y) muchie in graf}.

Un graf este neorientat dacă relațiile dintre noduri sunt bidirecționale: oricare ar fi $(x, y)$ în $E$, există și $(y, x)$ în $E$. Relațiile se numesc muchii.

Un graf este orientat dacă relațiile dintre noduri sunt unidirecționale: $(x, y)$ este în $E$ nu implică neapărat $(y, x)$ în $E$. Relațiile se numesc arce.

O componentă conexă (CC) este o submulțime maximală de noduri, cu proprietatea că oricare ar fi două noduri x și y din aceasta, există drum de la x la y. Pentru grafuri orientate, o componentă conexă se numește componentă tare conexă (CTC).

Un graf aciclic este un graf (orientat/neorientat) care nu conține cicluri.

Reprezentare

Problemele care se modelează folosind grafuri, de obicei, presupun explorarea spațiului. O parcurgere explorează fiecare nod al grafului, exact o singură dată, pornind de la un nod ales, numit în continuare nod sursă (EN: source). Modul de reprezentare al grafului poate influența performanța unei parcurgeri/unui algoritm.

Un graf poate fi modelat în mai multe moduri (folosind mai multe notații):

- printr-o pereche de mulțimi $G = (V, E)$

- $V$ = {v / v este un nod în graf} = mulțimea nodurile grafului (EN: nodes / vertices)

- $E$ = {e / $e=(x, y)$ este o muchie în graf între nodurile x și y} = mulțimea muchiile/arcelor (EN: edges), fiecare muchie stabilind o relație de vecinătate între doua noduri.

- printr-o pereche $G = (nodes, a)$

- $nodes$ = {node / node este un nod în graf}

- $a[x][y] = 0/1$

- 1 = există muchia/arcul (x, y)

- 0 = NU există muchia/arcul (x, y)

- printr-o pereche de mulțimi $G = (nodes, adj)$

- $nodes$ = {node / node este un nod în graf}

- $adj$ = {$adj[node]$ / unde $adj[node]$ este lista de adiacență a lui node} = reprezentarea grafului ca liste de adiacențe

- $adj[node] = {..., neigh, ...}$ ⇒ există muchie/arc (node, neigh)

Reprezentarea în memorie a grafurilor se face, de obicei, cu liste de adiacență. Se pot folosi însă și alte structuri de date, care vor fi introduse pe parcurs.

Cele mai uzuale notații din laboratoarele de grafuri sunt descrise în Precizări laboratoare 06-11 (ex. $n$, $m$, $adj$, $adj\_trans$, $(x, y)$, etc).

Colorare

Algoritmii de parcugere se pot folosi de o colorare a nodurilor:

- white (alb) = nod care nu a fost încă vizitat (nu este în coadă)

- gray (gri) = nod care este în curs de vizitare (a fost adăugat în coadă)

- black (negru) = nod care a fost complet vizitat (node scos din coadă și pentru care s-a vizitat tot subarborele)

Algoritmi de parcurgere

Problemă: Să se parcurgă un graf dat. Fiecare nod se parcuge (exact) o singură dată. Algoritmi:

- BFS

- DFS

BFS - Parcurgerea în lățime

Parcurgerea în lățime (Breadth-first Search - BFS) este un algoritm de căutare în graf, în care, atunci când se ajunge într-un nod oarecare node, nevizitat, se vizitează toate nodurile nevizitate adiacente lui (notate pe rand cu neigh), apoi toate vârfurile nevizitate adiacente vârfurilor adiacente lui node, etc.

Atenție! BFS depinde de nodul de start source. Plecând din acest nod, se vor vizita toate nodurile accesibile. De exemplu, într-un graf neorientat, aceste noduri accesibile formează o componentă conexă; în urma aplicării algoritmului BFS asupra fiecărei componente conexe a grafului, se obține un arbore de acoperire a întregului graf (prin eliminarea muchiilor pe care nu le folosim la parcurgere). Pentru a putea reconstitui acest arbore, se păstrează pentru fiecare nod dat identitatea părintelui său. În cazul în care nu exista o funcție de cost asociată muchiilor, BFS va determina și drumurile minime de la rădăcină la oricare nod.

Pentru implementarea BFS se folosește o coadă.

Algoritm

// do a BFS traversal from source // // source = the source for the BFS traversal // nodes = list of all nodes from G // adj[node] = the adjacency list of node // example: adj[node] = {..., neigh, ...} => edge (node, neigh) BFS(source, G=(nodes, adj)) { // STEP 0: initialize results // d[node] = distance from source to node // p[node] = parent of node in the BFS traversal started from source // [optional] color[node] = white/gray/black // * white = not yet visited // * gray = visit in progress // * black = visited foreach (node in nodes) { d[node] = +oo; // distance not yet computed p(node) = null; // parent not yet found // [optional] color[node] = white; } // STEP 1: initialize a queue q = {} // STEP 2: add the source(s) into q d[source] = 0; // distance from source to source p[source] = null; // the source never has a parent (because it's the root of the traversal) q.push(source); // [optional] color[source] = gray; // STEP 3: start traversal using the node(s) from q while (!q.empty()) { // while still have nodes to explore // STEP 3.1: extract the next node from queue node = q.pop(); // [optional] STEP 3.2: print/use the node // STEP 3.3: expand/visit the node foreach (neigh in adj[node]) { // for each neighbour if (d[node] + 1 < d[neigh]) { // a smaller distance <=> color[neigh] == white d[neigh] = d[node] + 1; // update distance p[neigh] = node; // save parent q.push(neigh); // add neigh to the queue of nodes to be visited // [optional] color[neigh] = gray; } } // [optional] color[node] = black; } }

Complexitate

- cu liste de adiacență: $O(n + m)$ sau $O(|V| + |E|)$

- cu matrice de adiacență: $O(n^2)$ sau $O(|V|^2)$

DFS - Parcurgerea în adâncime

Parcurgerea în adâncime (Depth-First Search - DFS) pornește de la un nod dat (node), care este marcat ca fiind în curs de procesare. Se alege primul vecin nevizitat al acestui nod (neigh), se marchează și acesta ca fiind în curs de procesare, apoi și pentru acest vecin se caută primul vecin nevizitat, și așa mai departe. În momentul în care nodul curent nu mai are vecini nevizitati, se marchează că fiind deja procesat și se revine la nodul anterior. Pentru acest nod se caută primul vecin nevizitat. Algoritmul se repetă până când toate nodurile grafului au fost procesate.

În urma aplicării algoritmului DFS asupra fiecărei componente conexe a grafului, se obține pentru fiecare dintre acestea câte un arbore de acoperire (prin eliminarea muchiilor pe care nu le folosim la parcurgere). Pentru a putea reconstitui acest arbore, păstram pentru fiecare nod dat identitatea părintelui sau.

Pentru fiecare nod se vor reține:

- $start[node]$ = timestamp-ul / timpul descoperirii

- $finish[node]$ = timestamp-ul / timpul finalizării

- $p[node]$ = părintele din parcugerea DFS a lui node

Spre deosebire de BFS, pentru implementarea DFS se folosește o stivă (abordare LIFO în loc de FIFO). În practică, stiva nu va fi reținută explicit - ci ne vom baza pe recursivitate.

Algoritm

// do a DFS traversal from all nodes // // nodes = list of all nodes from G // adj[node] = the adjacency list of node // example: adj[node] = {..., neigh, ...} => edge (node, neigh) // DFS(G=(nodes, adj)) { // STEP 0: initialize results // p[node] = parent of node in the BFS traversal started from source // start[node] = the timestamp (the order) when we started visiting the node subtree // finish[node] = the timestamp (the order) when we finished visiting the node subtree // [optional] color[node] = white/gray/black // * white = not yet visited // * gray = visit in progress // * black = visited foreach (node in nodes) { p[node] = null; // parent not yet found // [optional] color[node] = white; } timestamp = 0; // the first timestamp before the DFS traversal foreach (node in nodes) { if (p[node] == null) { // or [optional] color[node] == white DFS_RECURSIVE(node, G, p, timestamp) } } } DFS_RECURSIVE(node, G=(node, adj), p, ref timestamp) { start[node] = ++timestamp; // start visiting its subtree // [optional] color[node] = gray; for (neigh in adj[node]) { // for each neighbour if (p[neigh] == null) { // or [optional] color[neigh] = white; p[neigh] = node; // save parent DFS_RECURSIVE(neigh, G, p, timestamp); // continue traversal } } finish[node] = ++timestamp; // finish visiting its subtree // [optional] color[node] = black; }

Complexitate

- cu liste de adiacență: $O(n + m)$ sau $O(|V| + |E|)$

- cu matrice de adiacență: $O(n^2)$ sau $O(|V|^2)$

Tipuri de muchii/arce în parcurgerea DFS

Arborele de parcurgere DFS cuprinde toate nodurile din graf împreună cu muchiile/arcele pe vizitate de DFS. Dacă graful nu este conex / tare conex, se obțin mai mulți arbori care formează o pădure de arbori DFS.

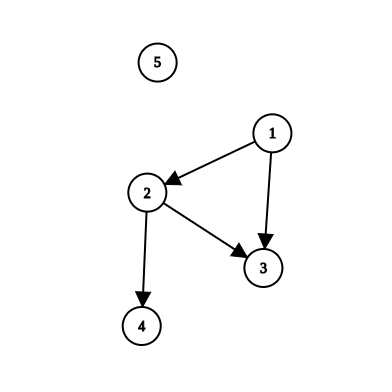

Exemplu:

- dacă în lista lui 1 avem nodurile 2 și 3, atunci când se va vizita 1, prima oară se încearcă vizitarea lui 2, apoi a lui 3.

- dacă în lista lui 1 avem nodurile 3 și 2, atunci când se va vizita 1, prima oară se încearcă vizitarea lui 3, apoi a lui 2.

Putem folosi o parcurgere DFS pentru a clasifica tipurile de muchii (toate muchiile din graf) relativ la arborele DFS curent.

tree-edge (T) / muchie de arbore = muchie (x, y) care conectează un nod x de copilul său y din arbore.

back-edge (B) / muchie înapoi = muchie (x, y) care conectează un nod x de un strămoș y (ambele noduri sunt în curs de vizitare).

Pentru graf orientat, mai există încă 2 tipuri de muchii (arce):

forward-edge (F) / muchie înainte /muchie de înaintare = muchie (x, y) care nu este tree-edge și care conecteză un nod x de un descendent y .

Într-un graf orientat muchiile (x, y) și (y, x) sunt diferite, deci pot avea tipuri diferite!

cross-edge (C) / muchie de traversare = muchie (x, y) care conectează un nod x de un nod y din alt subarbore.

Într-un graf orientat muchiile (x, y) și (y, x) sunt diferite, deci pot avea tipuri diferite!

Aplicații parcurgeri

- Componente Conexe

- Sortarea Topologică

- Componente Tare-Conexe

- Componente Biconexe

În acest laborator vom studia doar problema sortare topologică.

TopSort - Sortarea Topologică

Problemă

O sortare topologică într-un graf orientat aciclic reprezintă o aranjare/permutare a nodurilor din graf care ține cont de arce.

Orientarea muchiilor corespunde unei relatii de ordine de la nodul sursa catre cel destinație: dacă $(x,y)$ este un arc, $x$ trebuie să apară înaintea lui $y$ în inșiruire.

Algoritmi

Sunt doi algoritmi cunoscuti pentru sortarea topologică.

TopSort - DFS: sortare descrescătoare după timpul de finalizare

- se face o parcurgere DFS pentru determinarea timpilor de finalizare

- se sortează descrescător in functie de timpul de finalizare

- permutarea de noduri obținută este o sortare topologică

Optimizare: Pentru a evita sortarea nodurilor in functie de timpul de finalizare, se poate folosi o stiva ce retine aceste noduri in ordinea terminarii parcurgerii (sau un vector care la final este inversat).

Complexitate

- $T(n) = O(n + m)$

TopSort - BFS: algoritmul lui Kahn

- se initializeaza coada de la BFS cu toate nodurile din graf care au grad inten 0

- se porneste parcurgerea BFS

- la fiecare pas se vizitează un nod node

- se șterg toate muchiile care pleacă din node: $(node, neigh)$

- $neigh$ este adaugat in coada doar daca devine un nod cu grad intern 0

- se verifica la finalul parcugerii daca mai sunt muchii ramase in graf

- daca inca mai exista muchii neșterse, atunci graful conține cel puțin un ciclu - nu se poate determina o sortare topologică

- altfel, ordinea in care s-au scos nodurile din coada reprezinta o sortare topologica

Optimizare: Pentru a evita ștergerea propriu-zisă a muchiilor din graf, se poate modifica gradul intern al fiecărui nod (care poate fi reținut într-un vector $in\_degree[node]$).

Complexitate

- $T(n) = O(n + m)$

Concluzie

Ambele variante au aceeasi complexitate.

- Algoritmul bazat pe DFS nu verifica daca graful este ciclic: presupune corectitudinea inputului. Este relativ mai simplu de implementat.

- Algoritmul bazat pe BFS se poate folosi pentru a detecta daca graful este aciclic; in caz afirmativ, gaseste o sortare topologica valida.

TLDR

- Cele mai uzuale moduri de reprezentare a unui graf sunt: liste de adiacentă și matrice de adiacentă.

- Cele doua moduri uzuale de parcurgere a unui graf sunt: BFS și DFS.

- O aplicație importantă a parcurgerilor este Sortarea topologică - o modalitate de aranjare a nodurilor în funcție de muchiile dintre ele. În functie de nodul de start al DFS, se pot obține sortări diferite, păstrând însă proprietatile generale ale sortarii topologice.

Exerciții

Prin citirea acestor precizari vă asigurați ca:

- cunoasteți convențiile folosite

- evitați buguri

- evitați depunctări la lab/teme/test

Implementarea algoritmilor standard

Pool probleme (pentru prezentări)

1) Berării 2

Enunț: Se dă un graf orientat reprezentând o rețea de străzi și intersecții ale unui oraș, precum și locațiile în care se află berării. Se cere găsirea tuturor intersecțiilor din care nu se poate ajunge la nicio berărie, indiferent de traseul ales, respectând sensul unic al străzilor.

Date de intrare: Numărul de intersecții N, numărul de străzi M, numărul de berării P, urmate de M perechi de noduri (reprezentând străzile orientate) și de P numere reprezentând intersecțiile unde se află berării.

Date de ieșire: Numărul de intersecții din care nu se poate ajunge la o berărie, urmat de lista acestor intersecții, afișate în ordine crescătoare.

Problema se poate testa la:

Infoarena - Berării 2

2) Alee

Enunț: O parcare este formată din N × N pătrate de latură 1. Anumite pătrate sunt ocupate de copaci și nu pot fi traversate. Se cere determinarea numărului minim de pași necesari pentru a ajunge de la un pătrat de start la un pătrat de destinație, ocolind copacii. Se pot face pași doar pe orizontală și verticală (Nord, Sud, Est, Vest).

Date de intrare: Dimensiunea parcării N, numărul de copaci M, urmate de coordonatele celor M copaci și, la final, coordonatele punctului de plecare și cele ale punctului de sosire.

Date de ieșire: Un singur număr reprezentând distanța minimă (numărul de pași) între cele două poziții.

Problema se poate testa la:

Infoarena - Alee

3) Muzeu

Enunț: Un muzeu este reprezentat printr-o matrice de N × N zone. În muzeu există spații libere, pereți (obstacole) și mai mulți paznici. Trebuie să determinați, pentru fiecare zonă liberă, distanța minimă până la cel mai apropiat paznic, folosind doar deplasări sus/jos/stânga/dreapta.

Date de intrare: Un număr întreg N reprezentând dimensiunea muzeului, urmat de o matrice de N × N caractere, unde P este paznic, # este perete, iar . este zonă liberă.

Date de ieșire: O matrice N × N de numere întregi. Celulele conțin 0 dacă acolo este un paznic, -1 dacă este un perete, -2 dacă este o zonă în care nu poate ajunge niciun paznic, respectiv distanța minimă pentru zonele libere accesibile.

Problema se poate testa la:

Infoarena - Muzeu

4) Course Schedule

Enunț: Se dau N cursuri (numerotate de la 1 la N) și M cerințe. Fiecare cerință are forma: “cursul A trebuie finalizat înainte de a putea începe cursul B”. Se cere găsirea unei ordini valide în care un student ar putea să finalizeze toate cele N cursuri respectând aceste condiții.

Date de intrare: Numărul de cursuri N și numărul de cerințe M, urmate de M perechi de numere (A, B) reprezentând dependențele.

Date de ieșire: O permutare a celor N cursuri care respectă cerințele date. Dacă este imposibil să se finalizeze toate cursurile, se va afișa textul “IMPOSSIBLE”.

Problema se poate testa la:

CSES - Course Schedule

5) Insule

Enunț: O hartă este descrisă de o matrice cu N linii și M coloane. Elementele hărții pot fi 0 (apă) sau 1, 2, 3 (insule aparținând a trei țări diferite). Se cere aflarea numărului de insule din fiecare țară, precum și lungimea minimă a unui pod (format exclusiv din celule cu apă) care să unească o insulă a țării 1 de o insulă a țării 2.

Date de intrare: Dimensiunile hărții N și M, urmate de matricea de caractere formata din 0, 1, 2 și 3.

Date de ieșire: Patru numere: numărul de insule din grupa 1, grupa 2, grupa 3 și lungimea podului minim construit peste apă.

Problema se poate testa la:

Infoarena - Insule

Extra

Exerciții

Referințe

[0] Chapter Elementary Graph Algorithms, “Introduction to Algorithms”, Thomas H. Cormen, Charles E. Leiserson, Ronald L. Rivest and Clifford Stein

[1] https://en.wikipedia.org/wiki/Breadth-first_search