This is an old revision of the document!

TP 3 - Introduction à ANTLR4. Lexer

Ce TP est destiné à vous présenter le fonctionnement d'un lexer, son but étant de diviser un texte dans des parties identifiables, appelées jetons (tokens), comme dans l'exemple suivant.

En informatique, on va réaliser cette division à l'aide de l'outil ANTLR, spécialement créé pour traiter les textes structurés.

ANTLR4

ANTLR (ANother Tool for Language Recognition) est un générateur d'analyseurs pour lire, traiter, exécuter ou traduire du texte structuré ou des fichiers binaires. Il est largement utilisé pour créer des langages, des outils et des frameworks. À partir d'une description de langage formel, ANTLR génère un analyseur pour ce langage qui peut automatiquement créer des arbres d'analyse, dont on va discuter dans les cours et les TPs suivants. ANTLR génère également automatiquement des arborescences qu'on peut utiliser pour visiter les nœuds de ces arbres afin d'exécuter du code spécifique à l'application.

Configuration

L'outil nécessaire pour générer du code à partir d'ANTLR4 est écrit en Java. Donc, on a besoin seulement de l'archive ANTLR4 et d'un plug-in specialise pour Intelij.

Installation globale

- Télécharger le runtime complet d'ANTLR4 pour Java depuis ce lien. Le fichier

.jardoivent etre sauvegardé dans un dossier spécial que vous devrez créer sur votre ordinateur, C:\Javalib.

- Ajouter

antlr-4.11.1-complete.jarà la variable d'environnement CLASSPATH (aussi pour les variables de systeme que pour celles de votre utilisateur). Vous pouvez lire plus sur les variables d'environnement ici.

- Créer 2 fichiers batch.

- Le fichier

antlr4.batpermet d'utiliser antlr4 dans la ligne de commande depuis n'importe quel fichier. Il doit contenir la commande java org.antlr.v4.Tool %. - Le fichier

grun.batest utilisé pour tester le fichier d'entrée et pour afficher l'arbre d'analyse sous des formes différentes. Il doit contenir la commande java org.antlr.v4.runtime.misc.TestRig %*.

- Ajouter le dossier C:\Javalib a la variable d'environnement PATH.

- Vérifier l'installation en tapant

antlr4dans le Command Prompt.

Installation dans Intelij

- Telecharger le plugin ANTLR4 pour Intelij depuis ce lien. Redémarrer le programme Intelij apres l'installation.

- Créer un nouveau projet en Intelij et assurez-vous que c'est un project type 'Maven'.

- Entrez dans 'File > Settings' et assurez-vous que le plugin 'ANTLR v4' est active.

- Dans le fichier 'pom.xml', ecrivez les lignes suivantes, pour ajouter l'archive ANTLR dans notre projet.

- On doit aussi ajouter le fichier '.jar' dans le project, pour etre reconnu par Intelij. Entrez dans 'File > Project Structure', appuyez sur le menu 'Modules' et puis sur le boutton '+', et ajouter le fichier '.jar' qui est dans le directoire 'C:\Javalib'. Puis, appuyez sur 'Apply' et 'OK'.

- Redemarrer Visual Studio Code

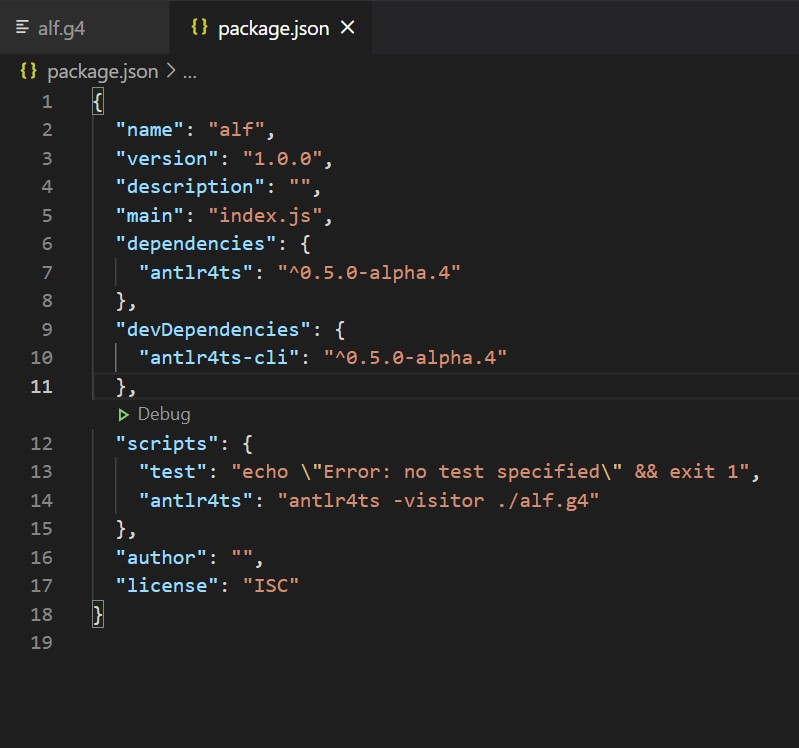

- Ajouter un nouveau script dans le fichier package.json avec le contenu

"scripts": { // ... "antlr4ts": "antlr4ts -visitor path/to/Alf.g4" }

- Configurer le fichier tsconfig.json.

{ "compilerOptions": { "target": "es2016", "module": "commonjs", "strict": true, "esModuleInterop": true, "skipLibCheck": true, "forceConsistentCasingInFileNames": true, "lib": ["es2016"], "moduleResolution": "node" } } - Télécharger les dépendences suivantes:

npm install --save-dev @types/node npm install --save-dev typescript

Lexer

En informatique, l'analyse lexicale, le lexing ou la tokenisation est le processus de conversion d'une séquence de caractères (comme dans un programme informatique) en une séquence de jetons (chaînes avec une signification attribuée et donc identifiée). Un programme qui effectue une analyse lexicale peut être appelé un lexer.

Un lexer est généralement combiné avec un parser, qui analysent ensemble la syntaxe des langages de programmation, des pages Web, etc. Dans ce chapitre, nous approfondirons uniquement les principes de construction d'un lexer, et nous discuterons des autres composants dans les TPs suivants.

Vous pouvez construire un lexer de deux façons:

- Ecrire un programme qui utilise des expressions régulières et faire correspondre ces expressions régulières à aux jetons

- Utilisez un générateur de lexer qui reçoit les expressions régulières et écrit le lexer pour vous

Rappel - Expressions régulières

Mathematique

| Character | Description | Exemple |

|---|---|---|

| * | Zéro ou plusieurs fois | a*, (ab)* |

| + | Une ou plusieurs fois | a+, (ab)+ |

| ? | Zéro ou une fois | a?, (ab)? |

| ^ | début de string | ^ab* |

| $ | fin de string | b*a$ |

| . | tout symbole | . |

| [ ] | Ensemble | [abc] |

| \s | Espace blanc | a\sb |

| [^ ] | ensemble complémentaire | [^abc] |

| ( ) | groupe | (abc)+ |

| | | Ou | a | b, (ab) | (ba) |

JavaScript

| Character | Description | Exemple |

|---|---|---|

| {n} | n fois | a{3} |

| {n,m} | minimum n, maximum m | a{3,7} |

| \w | alphanumérique et _ | \w |

| \t | TAB | a\ta* |

| \n | fin de ligne | a\nb |

| \r | retour chariot | a\rb |

| a(?!b) | a seulement si non suivi par b | a(?!b) |

| a(?=b) | a seulement si suivi par b | a(?=b) |

| ( ) | group | a(ab)a |

Pour déclarer des expressions régulières, on a 2 possibilités:

// making a new RexExp object the standard way let regex = new RegExp ("[0-9]+"); // making a new RegEx object using a shortcut let regex: RegExp = /[0-9]+/;

Lexer en ANTLR4

Ayant créé le projet TypeScript + ANTLR précédent, on va y ajouter un fichier Alf.g4 avec le contenu suivant:

grammar Alf; prog:; NEWLINE : ([\r\n]+); INT : ([0-9]+);

On peut observer la définition de 2 tokens différents (à l'aide des expressions régulières), NEWLINE et INT pour les nouvelles lignes, respectivement les numéros entiers.

Après avoir créé ce fichier, on va exécuter la commande npm run antlr4ts, qui va générer plusieurs fichiers .ts, ainsi que les fichiers .js nécessaires:

- Lexer: les règles de lexer sont destinées à créer des objets token correspondants

- Parser: les règles de parser sont responsables pour l'analyse du langage

- Listener: fournit des méthodes appelées indépendamment par un objet walker fourni par ANTLR

- Visitor: contient des méthodes qui doivent accompagner (walk) leurs enfants avec des appels de visite explicites

L'étape suivante suppose la création d'un fichier main.ts où l'on doit écrire la structure du programme et gestionner le fichier d'entrée:

import { CharStreams, CodePointCharStream, CommonTokenStream } from 'antlr4ts'; import { AlfLexer } from './AlfLexer'; import { AlfParser, ProgContext } from './AlfParser'; // Create the lexer and parser let input: string = "10\n20"; let inputStream: CodePointCharStream = CharStreams.fromString(input); let lexer: AlfLexer = new AlfLexer(inputStream); let tokenStream: CommonTokenStream = new CommonTokenStream(lexer); let parser: AlfParser = new AlfParser(tokenStream); // Parse the input, where `prog` is whatever entry point you defined let tree:ProgContext = parser.prog();

npx tsc- pour exécuter le compilateur TypeScriptnode main.js- pour exécuter le fichier principal JavaScript généré

Alf.g4), vous devez exécuter la commande suivante pour enregistrer les changements:

npm run antlr4ts

Exercices

- Traitez le tableau ci-dessous a l'aide des expressions régulières de sorte que chaque livre devienne un objet de type Book, avec les suivantes propriétés: titre (string), ISBN (number), et date de publication (string). (1p)

let books_array: string[] = [ 'Engineering a Compiler,9780120884780,7th February 2011', 'Modern Operating Systems 4,9780133591620,21st March 2014', 'Computer Networks,9332518742,9th January 2010' ];

- Installez ANTLR4 globalement, ainsi que la version pour TypeScript. Attachez une capture d'écran avec l'exécution de la commande

antlr4dans votre Command Prompt et une autre avec le résultat de la commandenpm run antlr4tsdans le Terminal de Visual Studio Code. (1p) - Créez le programme complet présenté dans le tutoriel de ce TP (fichiers de configuration, fichier Alf.g4, fichier main.ts) et assurez-vous que son exécution est réalisée sans d'erreurs. (1p)

- Affichez la liste des tokens: (1p)

- A l'aide des fonctions pour les strings, traitez le fichier

Alf.tokenscréé automatiquement par ANTLR et générez un dictionnaire qui ait comme clés l'indice de vos tokens et comme valeurs leur nom. (0.5p){ '1': 'NEWLINE', '2': 'INT' }

- Parcourez et affichez la liste des tokens (pour chaque token, affichez son nom et sa valeur comme dans l'exemple. Indice: Pour pouvoir afficher la liste des tokens, vous devrez inspecter la classe BufferedTokenStream et choisir une méthode qui retourne cette liste. Vous aurez aussi besoin de la fonction nextToken() pour parcourir le buffer de données. (0.5)

[{ '10': 'INT', '\n': 'NEWLINE', '20': 'INT' }

- Ajoutez a votre fichier

Alf.g4des expressions régulières pour les jetons suivants: WORD - tout texte contenant uniquement des lettres et PONCTUATION - différents signes de ponctuation. Utilisez le lexer créé dans l'exercice précédent pour afficher la liste des tokens pour le texte: Bonjour! Le TP d'ALF est de 8 a 10. (1p) - Utilisez votre lexer pour analyser les jetons du fichier text_and_numbers.txt. Pour chaque ligne de ce fichier affichez le texte du jeton, le type, et la ligne du fichier ou il a été trouvé. (1p)

- Ecrivez un lexer qui reconnaît un sous-ensemble du langage Python. Pour chaque point de cet exercice, utilisez comme exemple une chaîne quelconque correspondant au langage Python, pour voir si votre programme peut: (3p)

- Reconnaître les mots-clés suivants: for, if, while, else, def, break, class

- Reconnaître les noms des fonctions: ils commencent par une lettre ou _ et sont suivis de n'importe quelle lettre ou chiffre

- Reconnaître les nombres entiers

- Reconnaître les nombres à reels

- Reconnaître les variables

- Reconnaître les opérateurs: ( ) , ; : + - * / = % { } [ ]

- Utilisez le lexer de l'exercice précédent pour le fichier

program.py. Ecrivez chaque type de jeton, le texte qui lui correspond et la ligne où il a été trouvé. (1p) - Bonus: Modifiez le lexer de l'exercice 7 pour qu'il reconnaisse aussi des chaînes de caractères (texte encapsulé entre ” ou '). (1p)